Primera Generación De Computadoras; Historia, Y Evolución

El uso de la computadora ha cambiado nuestras vidas, podemos decir que tanto como el fuego y la rueda. Tanto es así que la invención y el desarrollo de estas máquinas se ha transmitido de generación en generación. Veamos hoy cómo era la primera generación de ordenadores.

Cuando consideras que lo que ahora es sólo otro elemento de tu habitación fue un descubrimiento de hace décadas que cambió la forma en que trabajamos en la vida, ofreciéndonos incontables comodidades sin censura que nadie quiere sacrificar.

Por esta razón, la historia del ordenador merece una atención especial, y aprovecho esta oportunidad para hablar de cómo comienza la primera fase del ordenador, para mostrar de qué está hecho, cómo evolucionó y cuál es su individualidad y, por supuesto, las mayores máquinas y... Ver toda la gama de ordenadores de todas las generaciones.

También puedes leer: Modelo OSI: Qué Es, Para Qué Sirve Y Cuál Es Su Importancia.

Características De La Primera Generación De Computadoras

Abarca el período comprendido entre 1940 y 1952, teniendo siempre en cuenta la fecha de comercio, reconocimiento o lanzamiento al mercado de las piezas. Por lo demás, si nos fijamos en la base cuando se utiliza el dispositivo, esto se extiende hasta 1958, porque es cierto que hasta ese año la característica principal de esta revolución se mantuvo como estándar.

Sus características, por cierto, son pequeñas y simples:

- Esto significa pasar de las máquinas de computación manuales y semimanuales al inicio de la computación automática y digital y el trabajo de cálculo.

- Estas máquinas se construirán utilizando sistemas de válvulas de vacío. Damos con tubos de vacío para intercambiar mecánica, relés, tarjetas perforadas, memorias de núcleo magnético...

- Sus dimensiones eran colosales, al igual que su consumo de energía.

- El lenguaje utilizado para programarlos fue el lenguaje de la máquina, el más simple de todos los inventos, un sistema de códigos que el circuito podía interpretar.

- Su propósito era específico (académico y militar, en principio) y se pretendía que se ordenaran.

Evolución De La Primera Generación De Computadoras

El origen de la computación se atribuye a la máquina analítica, por el inventor matemático C. Babbage. Su proyecto consistía en dar órdenes a la máquina para realizar cálculos, así como almacenar datos.

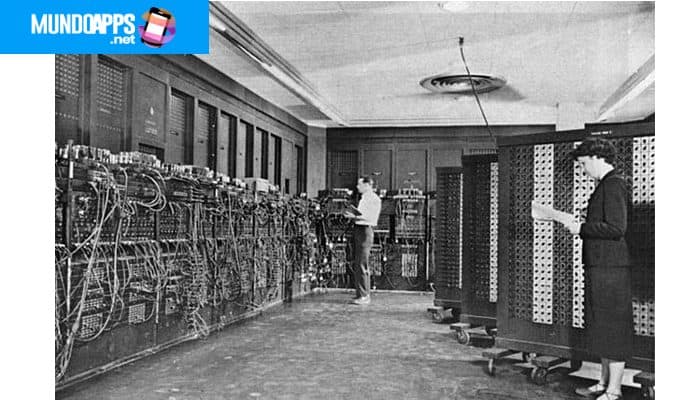

Aunque existían ideas similares en todo el planeta y los descubrimientos se hicieron al mismo tiempo, lo cierto es que históricamente la primera máquina informática reconocida es ENIAC, que es la madre de la idea anterior y fue a su vez el precedente del primer ordenador diseñado comercialmente, UNIVAC I.

Con este hito, el compilador también se introdujo en este modelo para poder interpretar dos idiomas diferentes. Otro gran desarrollo fue el sistema de cinta magnética, que podía ser interpretado en dos direcciones, y su obvia ventaja era la capacidad de detectar errores muy fácilmente.

Cuando se crearon los programas informáticos almacenados, la industria comenzó a temblar ante la "ferviente" demanda, varias docenas, porque esto significaba que la máquina no necesitaba ser reprogramada manualmente (lo que significaba un desmontaje casi completo y el reensamblaje de la máquina con las diferentes partes apropiadas programadas para un propósito determinado), sino que podía ser utilizada para diferentes propósitos, lo que la hacía mucho más versátil e interesante para un público cada vez más amplio.

Lenguajes De Programación De La Primera Generación De Computadoras

Una auto-modificación. Konrad Zuse había considerado esta posibilidad como "hacer un contrato con el Diablo" debido al potencial de abuso, y había elegido no implementarlo en sus máquinas. Pero la auto-modificación era esencial para lograr una verdadera máquina de uso general.

Uno de los primeros empleos de la automodificación fue la traducción del lenguaje de la computadora, "lenguaje" se refiere aquí a las instrucciones que hacen que la máquina funcione. Aunque las primeras máquinas funcionaban accionando interruptores, las máquinas de programas almacenados se manejaban con instrucciones codificadas almacenadas, y las convenciones para codificar estas instrucciones se denominaban el lenguaje de la máquina.

Escribir programas para las primeras computadoras significaba usar el lenguaje de la máquina. La forma del lenguaje de una máquina particular está dictada por su estructura física y lógica. Por ejemplo, si la máquina utiliza registros para almacenar los resultados intermedios de los cálculos, debe haber instrucciones para mover los datos entre dichos registros.

El vocabulario y las reglas de sintaxis del lenguaje de las máquinas tienden a ser muy detallados y muy alejados del lenguaje natural o matemático en el que se formulan normalmente los problemas. La conveniencia de automatizar la traducción de los problemas al lenguaje de las máquinas fue evidente inmediatamente para los usuarios, que tuvieron que convertirse ellos mismos en expertos en informática y programadores para poder utilizar las máquinas o tuvieron que recurrir a expertos y programadores que tal vez no entendieran plenamente los problemas que estaban traduciendo.

Por consiguiente, era necesario traducir automáticamente de las matemáticas puras o de algún otro "lenguaje de alto nivel" al lenguaje de las máquinas antes de que las computadoras fueran útiles para una clase más amplia de usuarios. Ya en la década de 1830, Charles Babbage y Lady Lovelace habían reconocido que tal traducción podía hacerse por máquina (ver la sección anterior Lady Lovelace, la primera programadora), pero no hicieron ningún intento de seguir esta idea y simplemente escribieron sus programas en lenguaje de máquina.

Nacen Los Lenguajes Especializados

Sin embargo, los programadores crearon lenguajes especializados de alto nivel, o HLL, para la enseñanza de la informática, incluso sin traductores automáticos para convertir sus programas en lenguaje de máquina. Simplemente hacían la traducción a mano. Lo hacían así porque al lanzar los problemas en un lenguaje de programación intermedio, a medio camino entre las matemáticas y el lenguaje altamente detallado de la máquina, tenían la ventaja de hacer más fácil la comprensión de la estructura lógica del programa y de corregir, o depurar, cualquier defecto en el programa.

Así pues, los primeros HLL eran todos métodos de papel y lápiz para refundir problemas en una forma intermedia que facilitaba la escritura de código para una máquina. Herman Goldstine, con contribuciones de su esposa, Adele Goldstine, y de John von Neumann, creó una representación gráfica de este proceso: diagramas de flujo. Aunque los diagramas eran sólo un dispositivo de anotación, fueron ampliamente difundidos y tuvieron gran influencia, evolucionando en lo que hoy se conoce como diagramas de flujo.

¿Quien Creo El Primer Lenguaje De Programación?

Konrad Zuse desarrolló el primer lenguaje de programación real, Plankalkül ("Cálculo del Plan"), en 1944-45. El lenguaje de Zuse permitía crear procedimientos (también llamados rutinas o subrutinas; trozos de código almacenados que podían ser invocados repetidamente para realizar operaciones rutinarias como la toma de una raíz cuadrada) y datos estructurados (como un registro en una base de datos, con una mezcla de datos alfabéticos y numéricos que representaban, por ejemplo, el nombre, la dirección y la fecha de nacimiento).

Además, proporcionaba declaraciones condicionales que podían modificar la ejecución del programa, así como repetir, o hacer bucles, declaraciones que hacían que un bloque marcado de declaraciones o una subrutina se repitiera un número determinado de veces o durante el tiempo que se mantuviera alguna condición.

Intérpretes

La codificación HLL se intentó desde el comienzo de la era de los programas almacenados a finales de la década de 1940. El código corto, o código de orden corto, fue el primer lenguaje de este tipo realmente implementado en la computadora BINAC en ese año y para el UNIVAC en 1950.

El código corto pasó por múltiples pasos: primero convirtió las declaraciones alfabéticas del lenguaje en códigos numéricos, y luego tradujo estos códigos numéricos al lenguaje de la máquina. Era un intérprete, lo que significa que traducía las declaraciones HLL y las ejecutaba, o las realizaba, de una en una, un proceso lento. Debido a su lenta ejecución, los intérpretes se utilizan ahora raramente fuera del desarrollo de programas, donde pueden ayudar a un programador a localizar errores rápidamente.

Compiladores

Una alternativa a este enfoque es lo que ahora se conoce como compilación. En la compilación, todo el programa HLL se convierte en lenguaje de máquina y se almacena para su posterior ejecución. Aunque la traducción puede llevar muchas horas o incluso días, una vez que el programa traducido se almacena, se puede recuperar en cualquier momento en forma de un programa en lenguaje de máquina de ejecución rápida.

En 1952 Heinz Rutishauser, que había trabajado con Zuse en sus ordenadores después de la guerra, escribió un influyente artículo, "Automatische Rechenplanfertigung bei programmgesteuerten Rechenmaschinen" (traducido libremente como "Conversión automatizada de código a lenguaje de máquina"), en el que sentó las bases de la construcción de compiladores y describió dos compiladores propuestos. Rutishauser participó más tarde en la creación de uno de los lenguajes de programación más cuidadosamente definidos de esta temprana era, ALGOL. (Ver la siguiente sección, FORTRAN, COBOL y ALGOL).

Sistemas Operativos De La Primera Generación De Computadoras

Para que las primeras computadoras fueran realmente útiles y eficientes, se necesitaban dos importantes innovaciones en el software. Uno eran los lenguajes de programación de alto nivel (como se describe en la sección anterior, FORTRAN, COBOL y ALGOL). El otro era el control. Hoy en día, las funciones de control de todo el sistema de una computadora generalmente se incluyen en el término sistema operativo o SO.

Un sistema operativo maneja las actividades detrás de escena de una computadora, como orquestar las transiciones de un programa a otro y administrar el acceso al almacenamiento en disco y los dispositivos periféricos. La necesidad de algún tipo de programa de supervisión se reconoció rápidamente, pero los requisitos de diseño de dicho programa eran desalentadores.

El programa de supervisión tendría que funcionar en paralelo con un programa de aplicación de alguna manera, vigilar sus acciones de alguna manera, y tomar el control cuando sea necesario. Además, la característica esencial y difícil de un programa de supervisión, incluso rudimentario, era la facilidad de interrupción. Tenía que ser capaz de detener un programa en ejecución cuando fuera necesario, pero guardar el estado del programa y todos los registros para que, una vez terminada la interrupción, el programa pudiera reiniciarse desde donde lo dejó.

La primera computadora con un sistema de interrupciones tan verdadero fue el UNIVAC 1103A, que tenía una sola interrupción activada por una condición fija. En 1959, Lincoln Labs TX2 generalizó la capacidad de interrupción, lo que hizo posible establecer varias condiciones de interrupción bajo el control del software. Sin embargo, sería una empresa, IBM, que crearía y dominaría un mercado de computadoras comerciales. IBM estableció su primacía principalmente a través de una invención: el sistema operativo IBM 360.

Los IBM 360

IBM había estado vendiendo máquinas comerciales desde principios de siglo y había construido la computadora de Howard Aiken según sus especificaciones arquitectónicas. Pero la compañía había tardado en implementar la arquitectura de computadora digital de programa almacenado de principios de la década de 1950. Desarrolló la IBM 650, una implementación decimal (como UNIVAC) del plan IAS, y la primera computadora en vender más de 1,000 unidades.

La invención delEl transistor en 1947 llevó a IBM a rediseñar sus primeras máquinas, pasando de la tecnología electromecánica o de tubo de vacío a la tecnología de transistores a fines de la década de 1950 (aunque el UNIVAC Modelo 80, entregado en 1958, fue la primera computadora con transistores). Estas máquinas transistorizadas se denominan comúnmenteComputadoras de segunda generación.

También puedes leer: Cómo Identificar Qué Placa Base Tengo En Windows 10

Deja una respuesta